什么是机器学习

机器学习是人工智能的一个分支,它让计算机从数据中自动“学”到知识,并用这些知识做决策或预测,而不需要我们一步步明确地告诉它怎么做。

传统数学 vs 机器学习

相同点

- 数据驱动: 两者都利用数据来构建和验证模型。

- 预测和推断: 数学建模和机器学习都可以用于预测未知的输出或解释数据中的模式。

- 优化问题: 在某些情况下,两者都可能涉及到优化问题,例如,寻找最小化误差的参数。

不同点

- 数学建模:旨在用数学的形式来描述现实世界中的现象或问题,往往为了理解其背后的机制或原理。

- 主要关注的是预测和泛化。机器学习模型可能不太关心背后的机制,而是关心在未知数据上的性能。

- 数学建模:模型的形式通常基于对现象的物理、生物或经济学的理解。例如,描述人口增长的模型可能基于出生率和死亡率的估计。

- 机器学习:模型的形式主要基于数据。使用的模型可能没有明确的现实意义,例如深度学习模型。

- 数学建模:模型的验证通常基于其是否与现实世界的观察相符合,以及其是否可以提供洞察力。

- 机器学习:验证通常基于模型在独立测试集上的性能。

- 数学建模:模型往往更具解释性,因为它们是基于现象的某些已知原理或规律构建的。

- 机器学习:尤其是某些复杂的模型,如深度神经网络,可能难以解释。尽管如此,机器学习领域也有许多工作在努力提高模型的可解释性。

- 数学建模:常应用于工程、物理学、经济学等领域,以帮助专家了解和控制系统。

- 机器学习:广泛应用于计算机视觉、自然语言处理、推荐系统等领域,主要关注自动化和预测。

- 数学建模:往往倾向于使用更简单的、基于物理学或其他学科原理的模型。

- 机器学习:可能使用非常复杂的模型,特别是当数据量大且复杂度高时。

总的来说,数学建模和机器学习都是理解、解释和预测现象的工具,但它们的关注点、方法和应用有所不同。

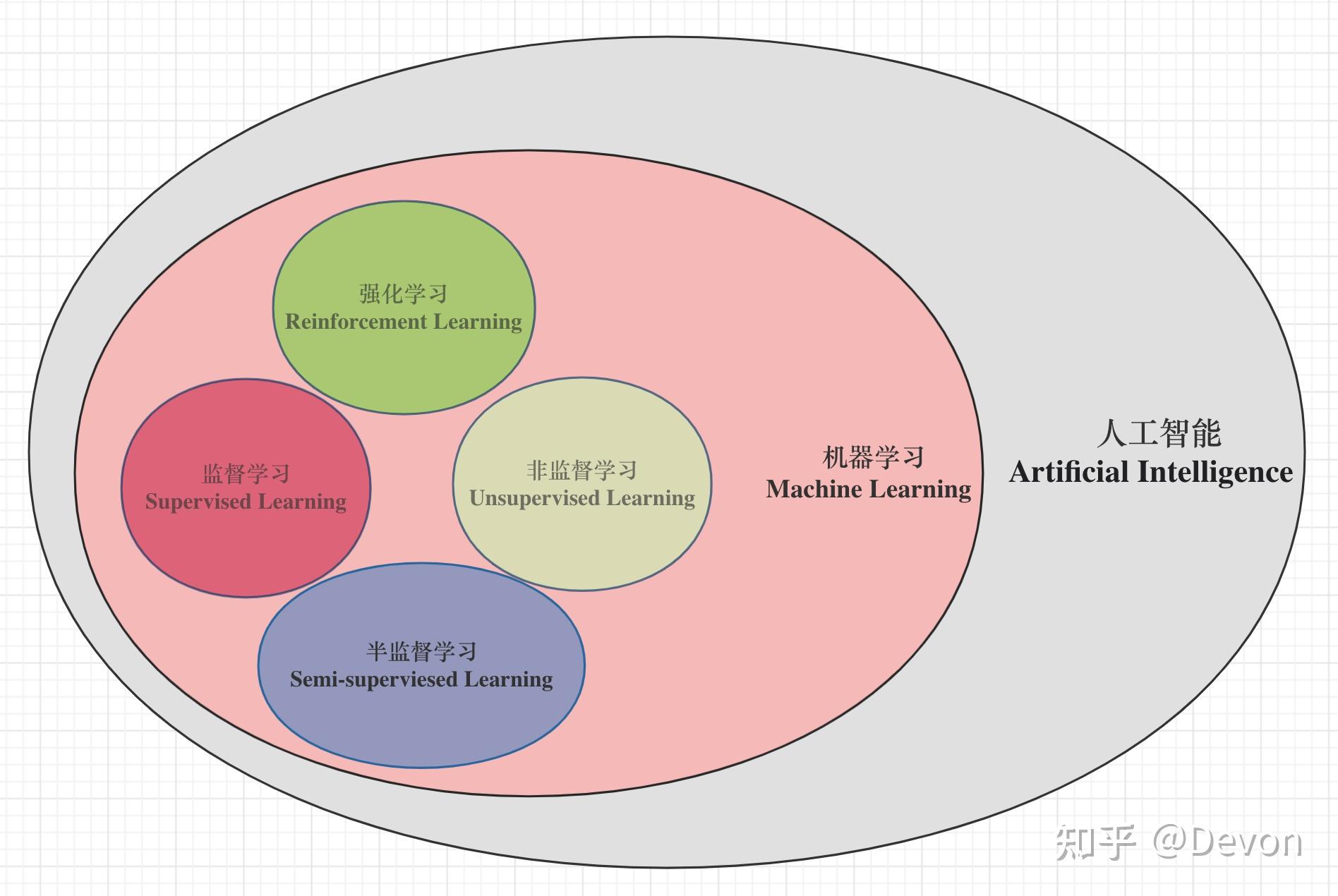

主要类别

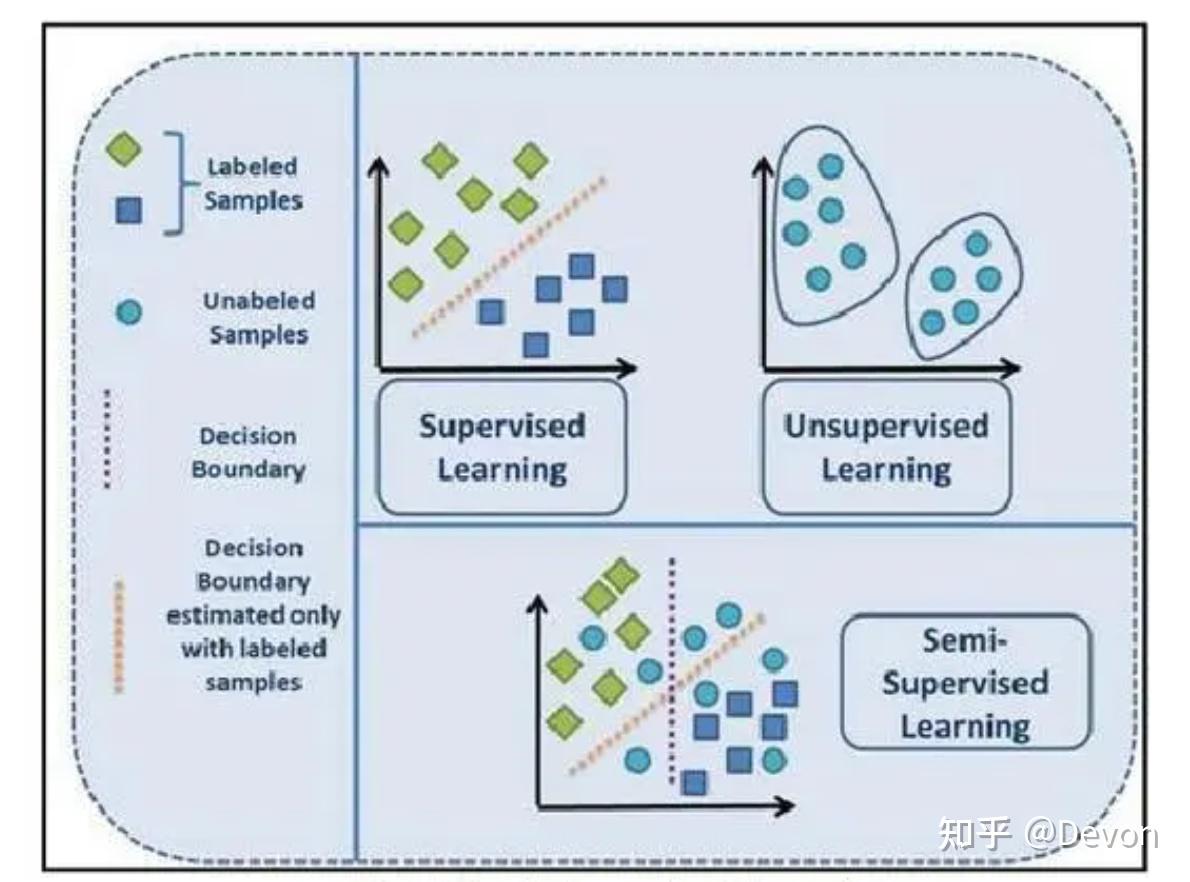

机器学习主要分为三大类:监督学习、非监督学习、强化学习,而监督学习和非监督学习中又衍生出半监督学习。

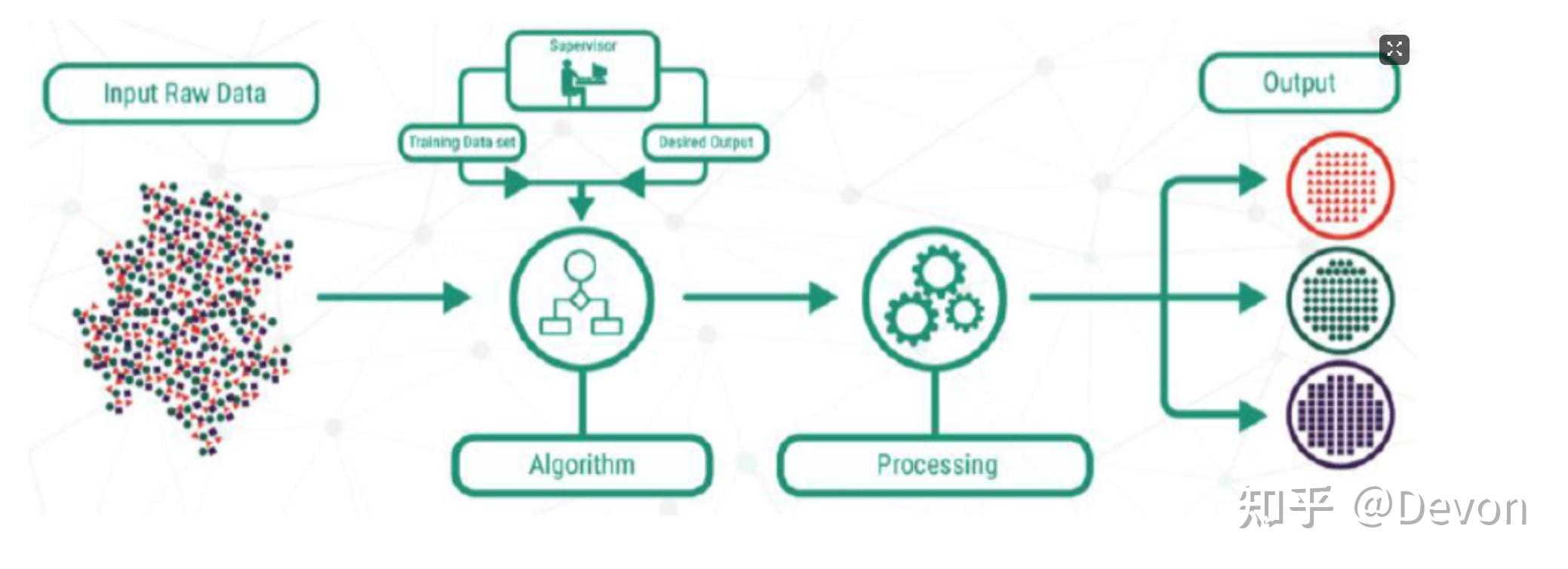

监督学习

Supervised Learning是机器学习的一种方法,其模型是通过输入-输出(有标签的数据)对进行训练,目标是从给定的数据中学习一个映射函数,以便在给定新的输入时,模型可以预测相应的输出 。训练过程涉及到输入数据和其相应的标签,并尝试找到这两者之间的关系。一旦模型被训练,它可以用来预测新、未标签数据的输出。

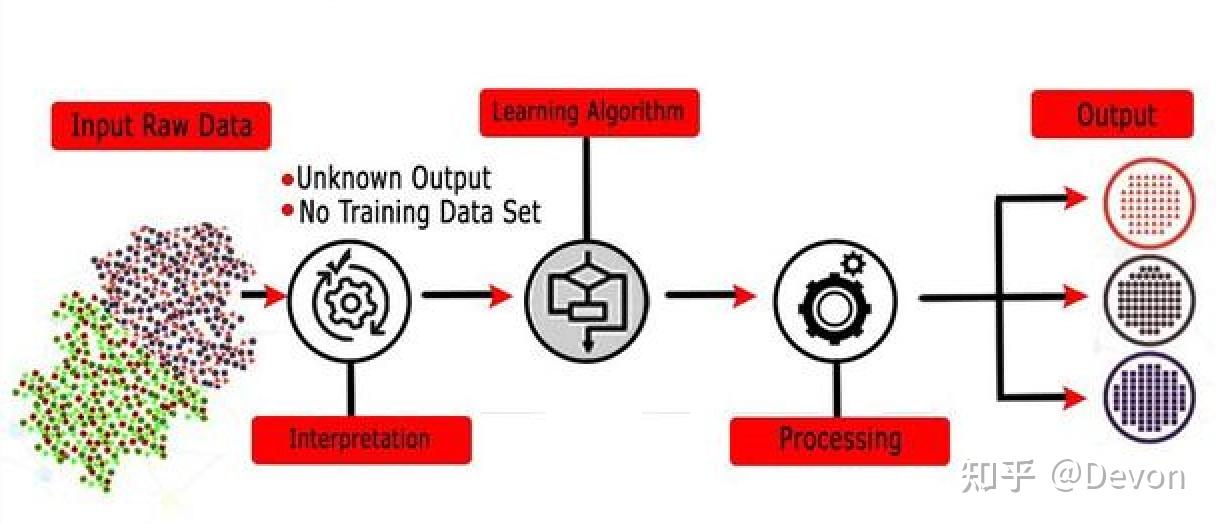

非监督学习

Unsupervised Learning模型被训练在没有标签的数据上。它的目的是学习数据的底层结构、分布或表示,而不是预测标签。与监督学习不同,非监督学习的目标并不是预测一个输出。相反,它试图通过某种方式学习数据的结构,这可以是通过聚类、降维或生成模型等方式来实现的。

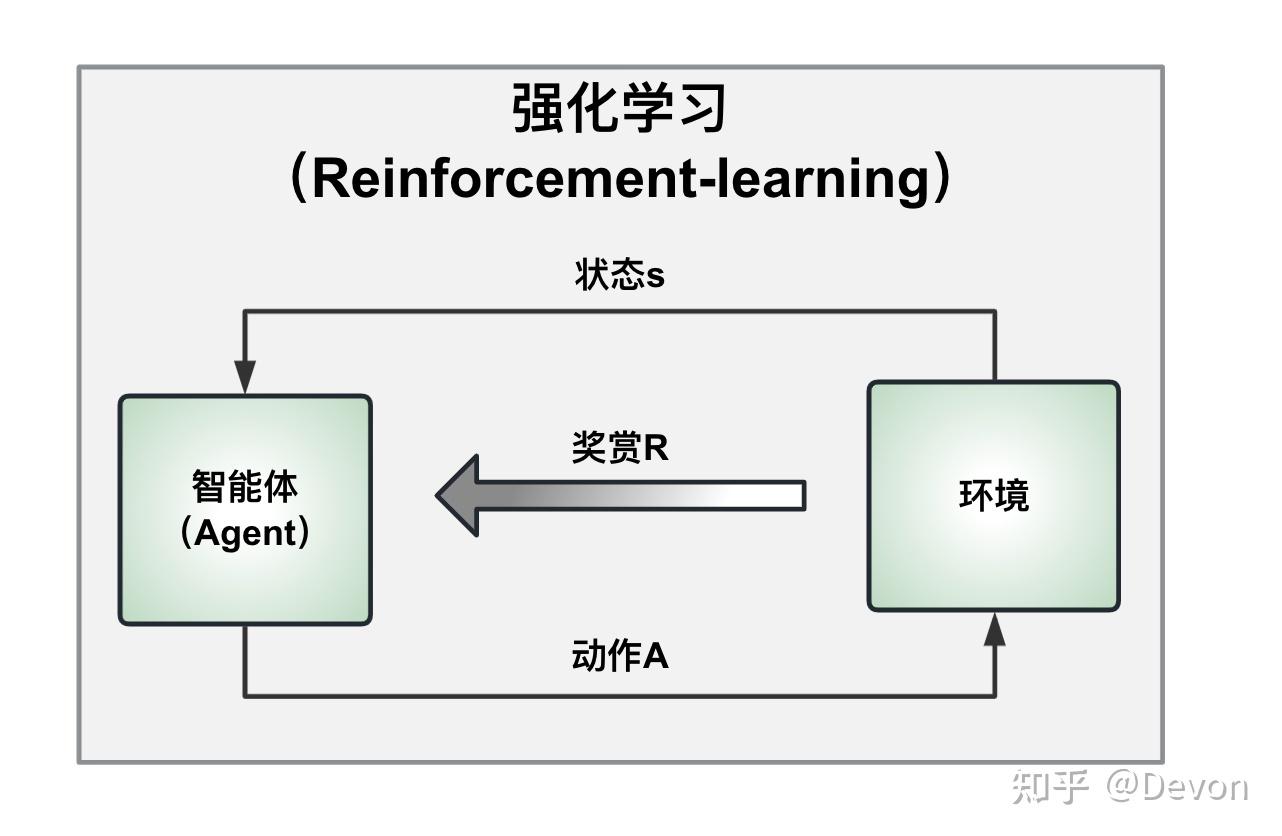

强化学习

Reinforcement Learning是通过与环境交互来学习如何行动,从而最大化某种定义的长期回报。与传统的监督学习不同,强化学习通常涉及决策问题,其中每个行动都会影响未来的回报。

半监督学习

Semi-supervised Learning是介于两个极端之间(监督式是指整个数据集被标记,而非监督式是指没有标记)。半监督学习任务具有一个标记和一个未标记的数据集。它使用未标记的数据来获得对数据结构的更多理解。通常,SSL使用小的带标签数据集和较大的未带标签数据集来进行学习。)学习正如其名称所示,介于两个极端之间(监督式是指整个数据集被标记,而非监督式是指没有标记)。半监督学习任务具有一个标记和一个未标记的数据集。它使用未标记的数据来获得对数据结构的更多理解。通常,SSL使用小的带标签数据集和较大的未带标签数据集来进行学习。

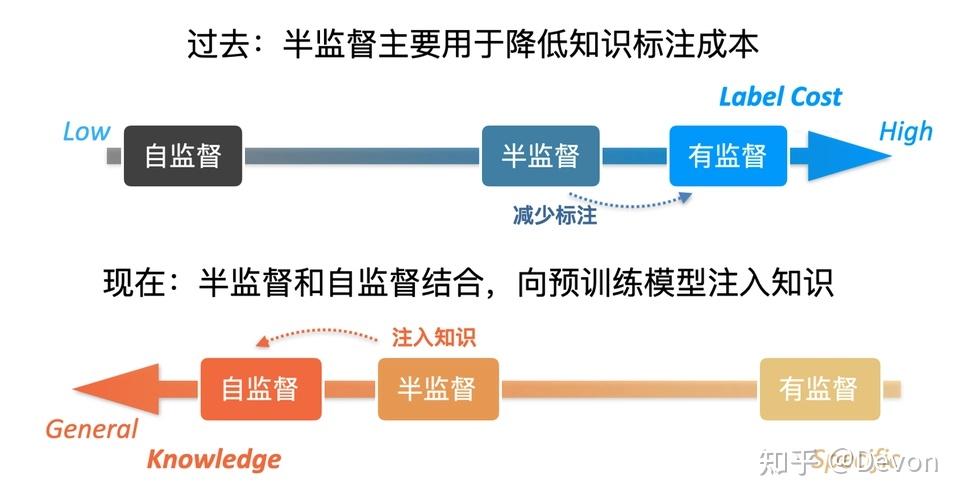

为什么会用半监督学习

半监督学习位于监督学习和非监督学习之间,利用少量的标记数据和大量的未标记数据进行学习。以下是为什么要使用半监督学习的原因:

- 数据标注成本高 :在很多应用中,收集大量数据是相对容易的,但为这些数据打标签则既昂贵又耗时。例如,在医学图像领域,一个专家可能需要花费大量时间来手动标注图像中的特定结构或病变。利用半监督学习,可以用少量的标注数据和大量的未标注数据共同训练模型。

- 利用数据的完整潜力 :未标记的数据包含有关数据分布的有用信息。半监督学习方法尝试利用这些信息来改善模型的性能。

- 提高泛化能力 :在某些情况下,利用大量的未标记数据可以帮助模型更好地泛化到新的、未见过的数据。

- 数据标注可能存在误差 :在某些场景中,即使数据被标注,标签也可能存在噪音或误差。在这种情况下,使用半监督学习方法,结合大量的未标记数据,可能会提供一个更稳健的学习策略。

- 在某些任务中,有很多相关的未标记数据 :例如,在自然语言处理中,我们可能有少量标记的数据集,但可以从网络上轻松获得大量的相关文本。半监督学习可以利用这些未标记的文本来提高模型的性能。

- 适应数据的变化 :在动态环境中,数据分布可能随时间而变化。利用半监督学习,可以定期利用新收集的未标记数据来更新模型,使其适应变化。

总之,半监督学习提供了一种在有限标记数据的情况下利用未标记数据的方法,这对于许多实际应用来说是非常有价值的。

模型

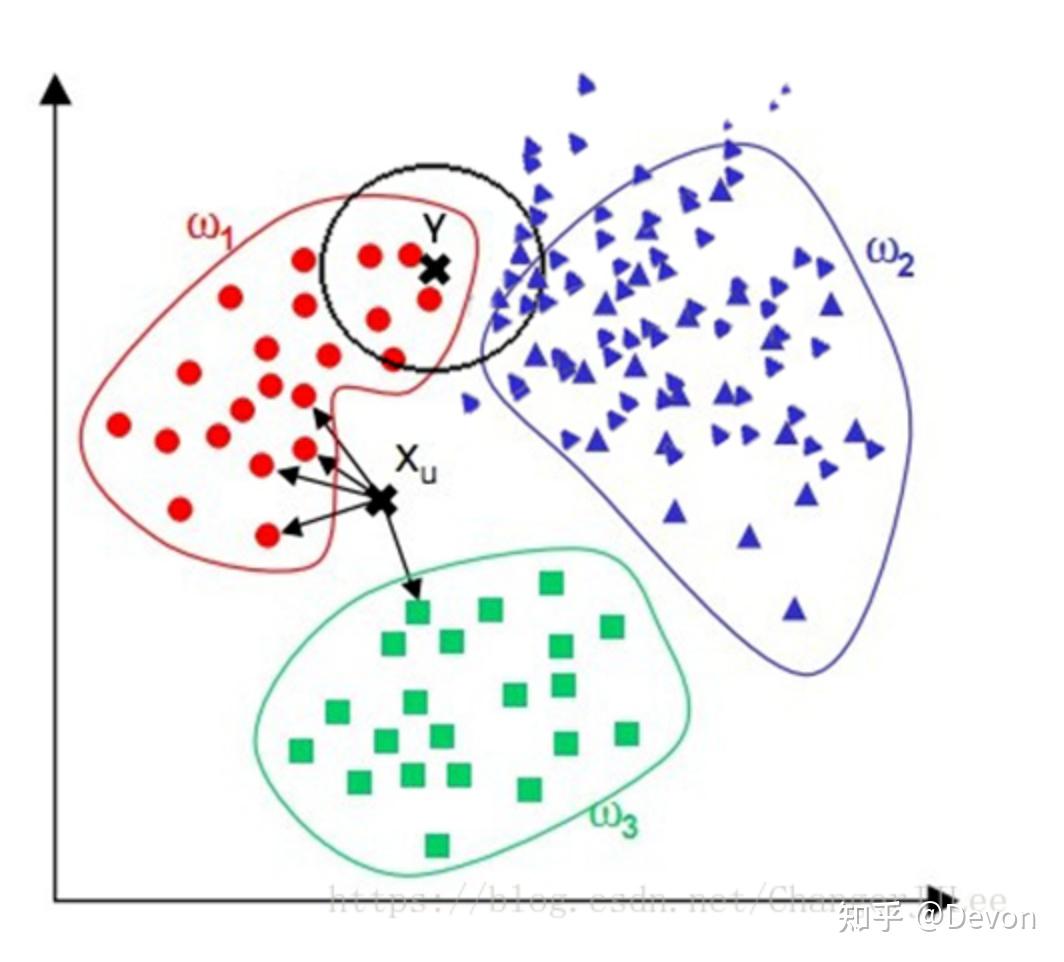

K近临

K Nearest-Neighbours是一种监督学习技术,给定一个新的观测值,KNN算法会从训练数据集中搜索出k个与其最相似的实例,然后基于这些邻居的属性来预测新观测值的标签。

原理

- 距离计算 :对于给定的新数据点,计算它与训练数据集中每个点的距离。

- 选取K个邻居 :从训练数据集中选取距离最近的K个点。

- 投票 (对于分类) :对于K个邻居,看哪个类别最为常见,并将其指定为新数据点的类别。

- 平均 (对于回归) :对于K个邻居,计算其属性的平均值,并将其指定为新数据点的值。

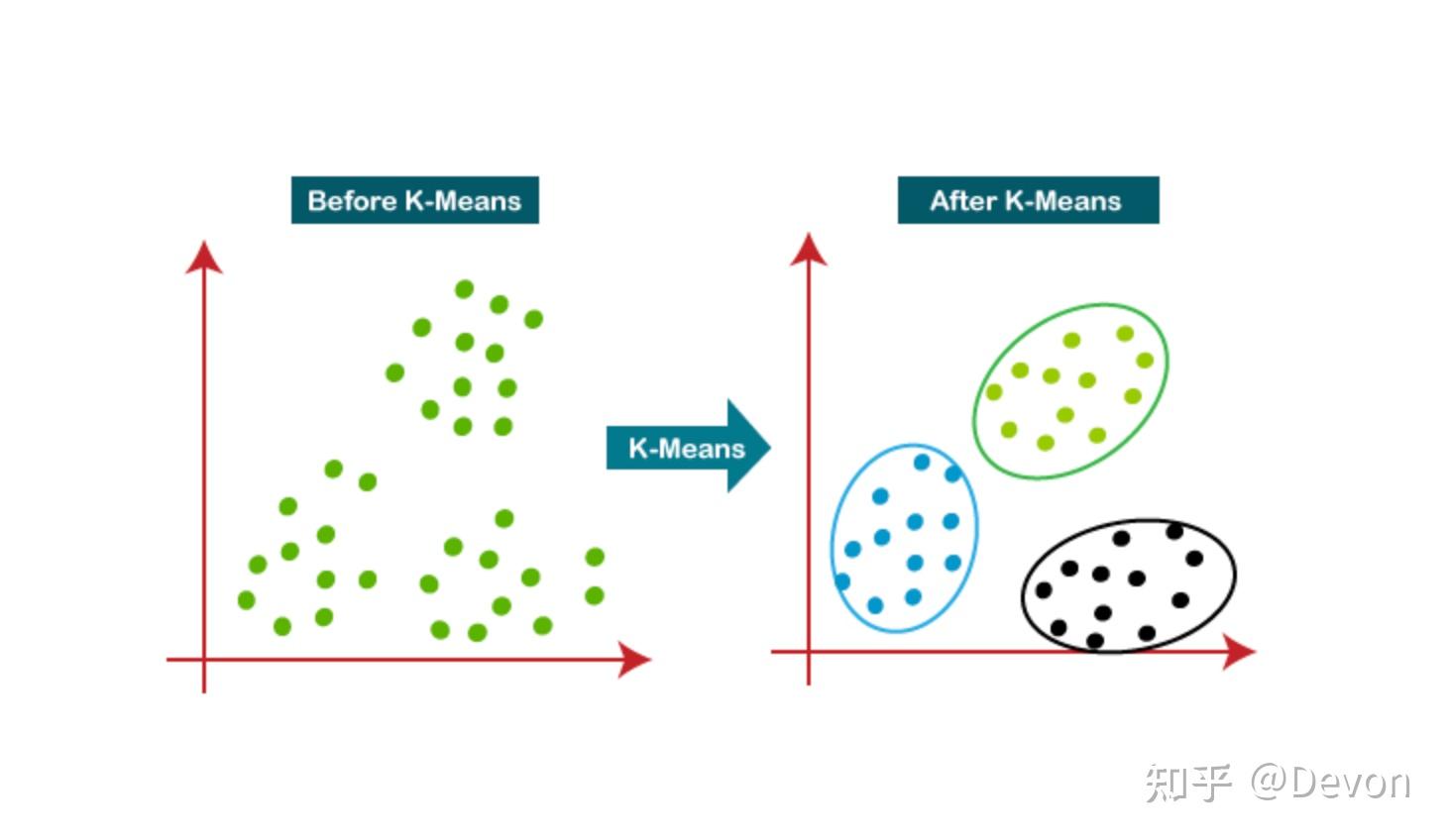

K均值

K-Means Clustering是一种无监督的聚类算法,其目的是将n个数据点分为k个聚类。每个聚类都有一个中心,这些中心最小化了其内部数据点与中心之间的距离。

原理

- 初始化: 随机选择k个数据点作为初始聚类中心。

- 分配: 为每个数据点分配最近的聚类中心。

- 更新: 计算每个聚类的平均值,并将平均值设为新的聚类中心。

- 重复: 重复步骤2和3,直到聚类中心不再显著变化。

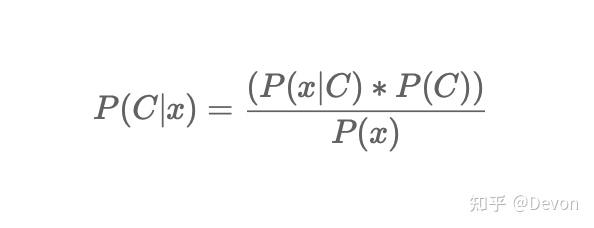

朴素贝叶斯

Naive Bayes Classifier监督学习技术是基于贝叶斯定理的一种简单概率分类器。它假设特征之间是独立的(这就是“朴素”一词的来源),即一个特征的出现不会影响另一个特征的出现。

原理

给定一个类别 C 和一个特定的特 x ,贝叶斯定理表示为:

其中

- P(C|x) 是在给定特征 x 的情况下类别 C 的后验概率。

- P(x|C) 是在类别 C 的情况下观察到特征 x 的概率。

- P(C) 是类别 C 的先验概率。

- P(x) 是观察到特征 x 的概率。

对于分类问题,我们可以忽略分母(因为它对所有的类别都是相同的)并计算每个类别的P(C)×P(x∣C)。我们将数据点分类为给出最大值的类别。

回归方法

Regression METHods是一种预测性监督学习技术,它研究的是因变量(目标)和自变量(预测器)之间的关系。 这种技术通常用于预测分析,时间序列模型以及发现变量之间的因果关系。

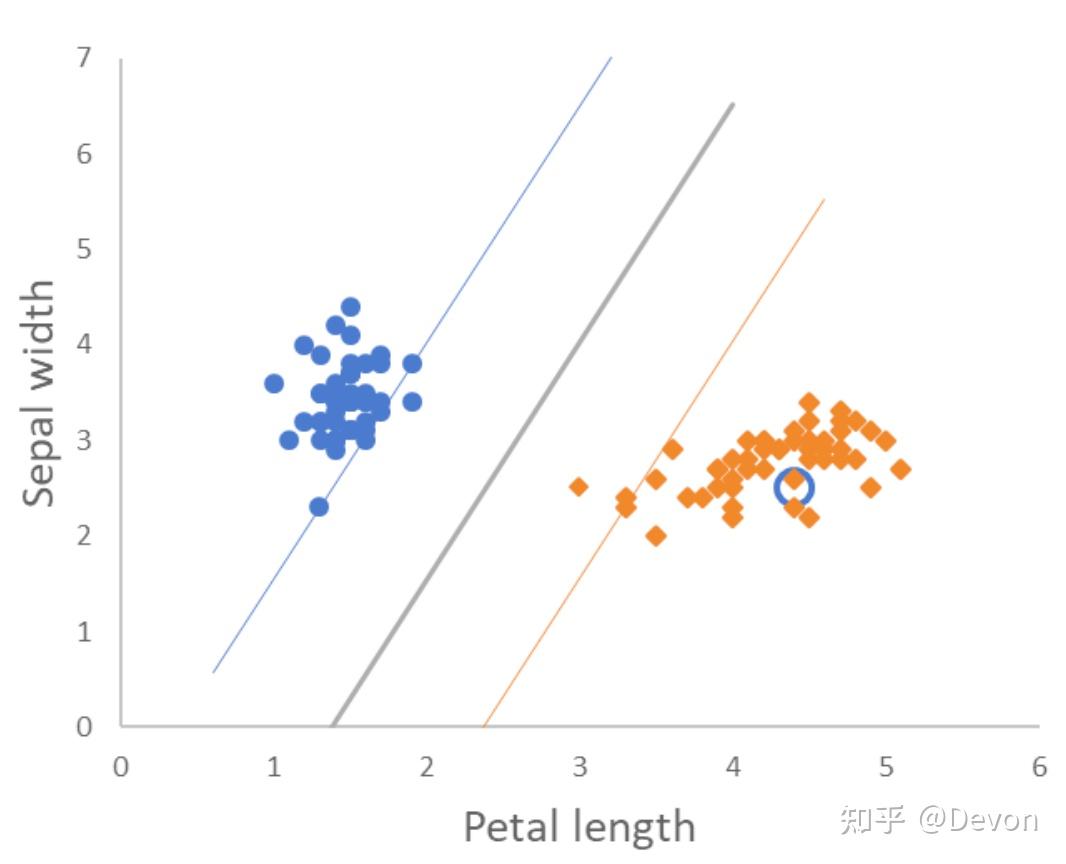

支持向量机

Support Vector Machines, SVM)是一种在分类和回归分析中使用的监督学习模型,基本思想是找到一个超平面,使得两个类别之间的边界最大化。对于线性可分的数据,这意味着超平面可以完美地分隔两个类别,并且最大化与最近的训练数据点(即支持向量)之间的距离。SVM使用所谓的核方法进行扩展。核方法的思想是将数据映射到一个更高维度的空间,使其在新的空间中变得线性可分。

自组织映射

Self-Organizing Maps,简称SOM是一种无监督学习的神经网络,SOM是一种将高维数据映射到通常是二维(有时是三维)的网格结构上的方法。与其他神经网络不同,SOM没有激活函数,它根据输入特征的相似性将相似的输入向量组合在一起。

原理

- 初始化 :为每个节点(或称为神经元)随机初始化一个权重向量。

- 竞争 :对于每个输入样本,找到与其最相似(即欧几里得距离最近)的权重向量的节点,这个节点被称为胜者节点(winning node)。

- 适应 :更新胜者节点和其邻居节点的权重向量,使它们更接近当前输入样本。邻居节点的定义和更新的幅度都随时间逐渐减少。

- 迭代 :对于大量的迭代,重复上述步骤,直到模型收敛。

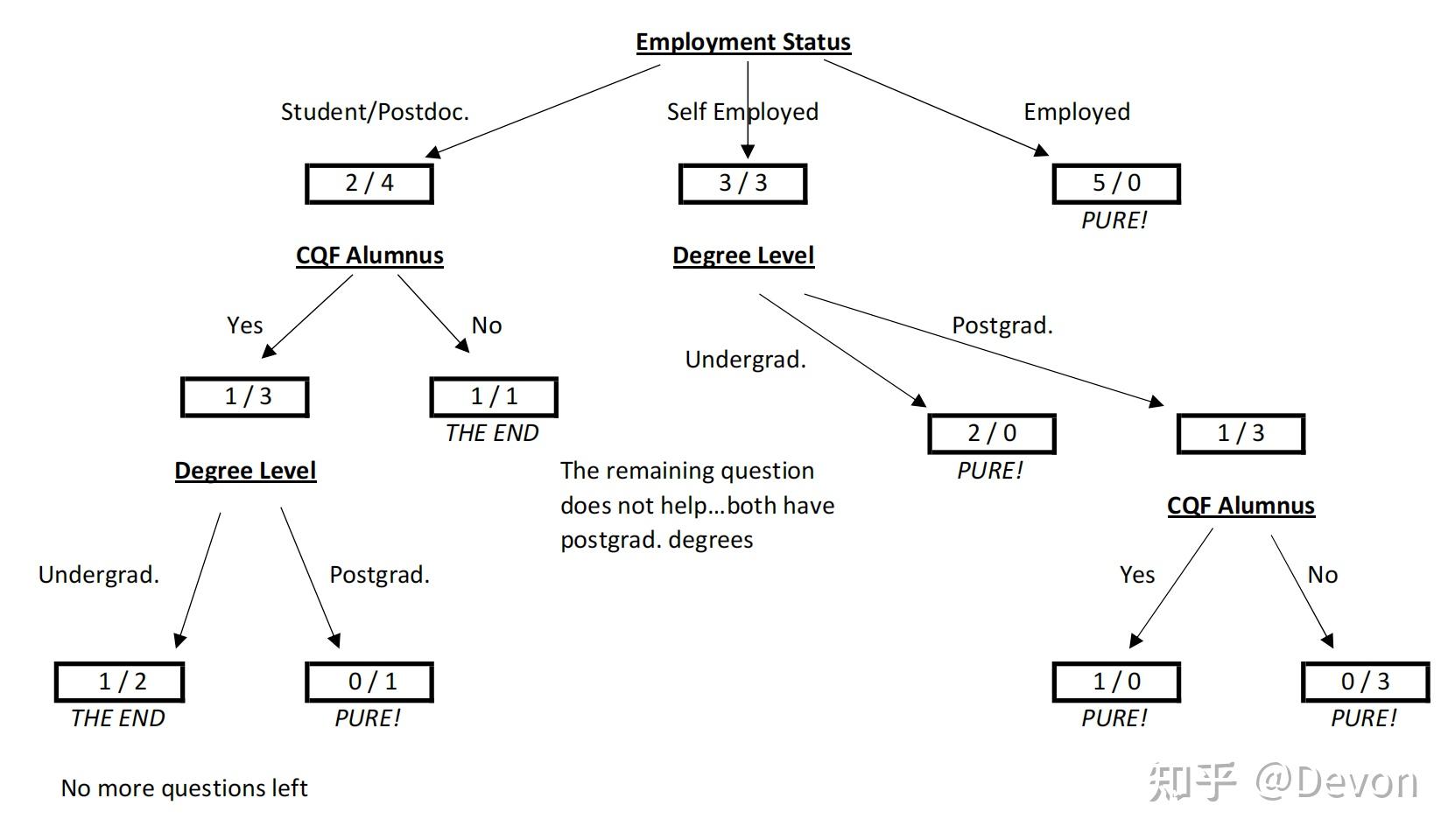

决策树

Decision Trees是一种监督学习模型、主要用于分类和回归任务,决策树是一个树形结构,其中每个内部节点表示一个特征属性上的测试,每个分支代表一个测试结果,每个叶节点代表一个类别(在分类任务中)或连续的值(在回归任务中)。

原理

决策树通过一系列基于特征值的测试,将输入数据点分配到叶节点中的一个,从而完成分类或预测任务。

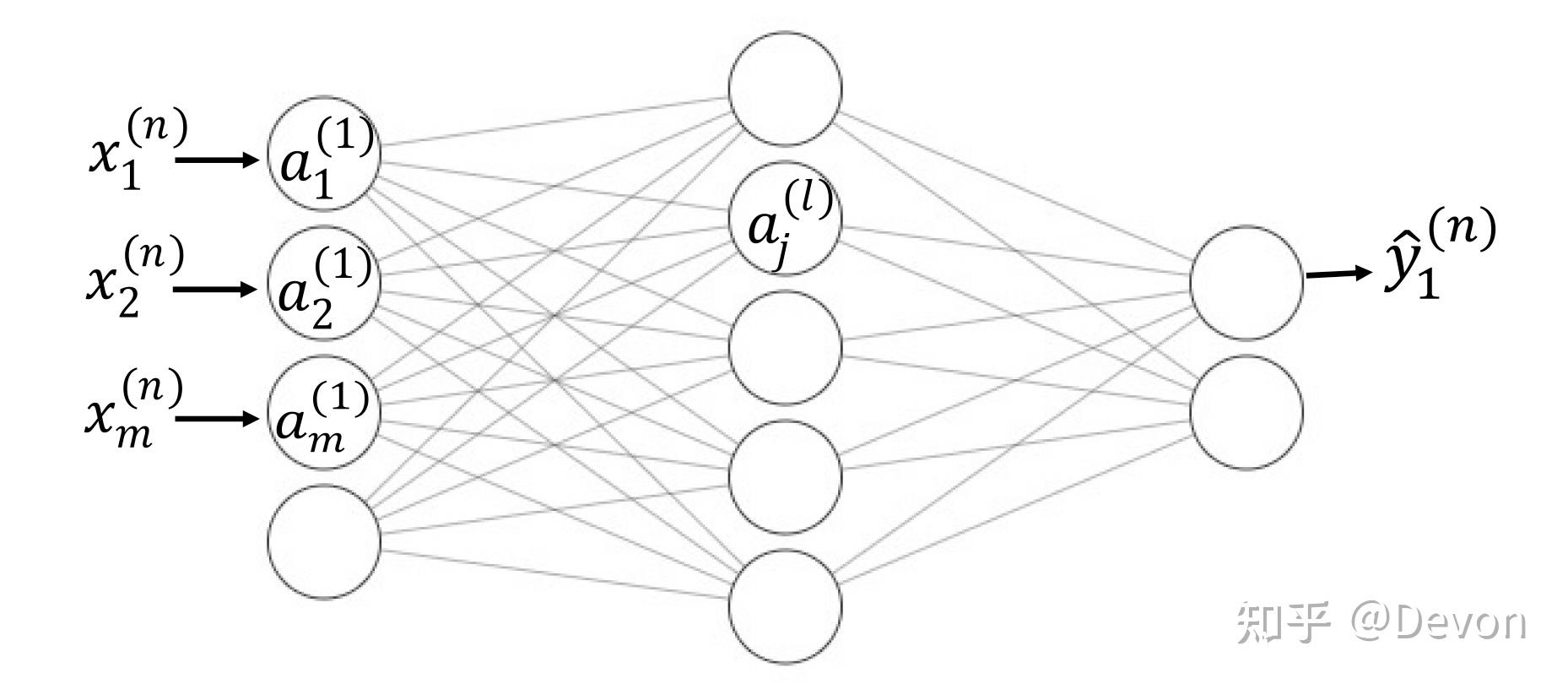

神经网络

Neural Networks是一种模仿生物神经网络结构和功能的计算模型。

基本结构

- 神经元(Neuron) : 神经网络的基本单元。每个神经元接收一个或多个输入,加权处理这些输入,然后产生一个输出。

- 层(Layer) :神经网络由多层神经元组成。主要有三种类型的层:

- 输入层(Input Layer) :接收外部数据的层。

- 隐藏层(Hidden Layers) :在输入层和输出层之间的层,可以有多个。

- 输出层(Output Layer) :产生最终预测或分类的层。

工作原理

每个神经元的输入都与一个权重相乘,所有加权输入的总和加上一个偏置,然后传递给激活函数。激活函数的输出是该神经元的输出。

|