建议从感知器到多层神经网络,来了解一下神经网络及深度学习的原理、主流应用模型及范围。

1943 年,心理学家沃伦·麦卡洛克(Warren McCulloch)和数理逻辑学家沃尔特·皮茨(Walter Pitts)提出并给出了人工神经网络的概念及人工神经元的数学模型,从而开了人类神经网络研究的先河。世界上第一个人工神经元叫作 TLU (Threshold Linear Unit,即阈值逻辑单元或线性阈值单元)。最初的模型非常简单,只有几个输入端和输出端,对权值的设置和对阈值的调整都较为简单。

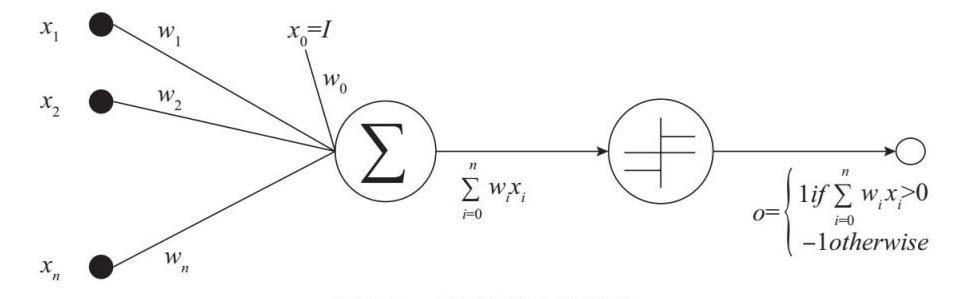

1957 年,一个开创性的人工神经网络在康奈尔航空实验室诞生了,它的名字叫作感知器(Perceptron),由弗兰克·罗森布莱特(Frank Rosenblatt)提出,这也是首次用电子线路来模仿神经元。他的想法很简单,如图 3.1 所示:将其他电子神经元的几个输入按照相应的权重加在一起,如果它们的和大于一个事先给定的值,输出就打开,让电流通向下一个神经元;如果小于这个事先给定的值,输出就关闭,没有电流流向下一个神经元。

1960 年,斯坦福大学教授伯纳德·威德罗(Bernard Widrow)和他的第一个博士生马尔西安·泰德·霍夫(Marcian Ted Hoff)提出了自适应线性神经元(ADaptive LInear NEurons,ADLINE)。他们第一次提出了一种可以自动更新神经元系数的方法( 机器自我学习的原始起点 ):用输出误差的最小均方去自动迭代更新神经元权重系数,直至输出信号和目标值的误差达到最小。这样就实现了权重系数可以自动连续调节的神经元。自适应线性神经元最重要的贡献是第一个使用输出信号和目标值的误差自动反馈来调整权值,这也为后面神经网络发展历史上里程碑式的反向传播算法奠定了基础。

图 3.1 感知器的电子线路

这个单层的神经网络也被称为自适应信号处理器,被广泛应用在通信和雷达当中。霍夫后来加入英特尔,在 1971 年设计了世界上第一个微处理器 Intel 4004。威德罗教授也是笔者 20 世纪 80 年代后期在斯坦福大学的博士生导师。笔者曾经在他的指导下做过神经网络的研究工作。图 3.2 是笔者 2016 年和他讨论神经网络未来发展时的合影,笔者手中拿的那个黑盒子就是他 1960 年做出的 ADLINE 单层神经网络。这个盒子到今天还在工作,美国国家博物馆曾经想要这个盒子做展品,但威德罗教授回答说「我还要用它来教学」。

图 3.2 笔者和自己当年斯坦福大学的博士导师,神经网络鼻祖之一威德罗教授的合影

威德罗教授在 1962 年还提出过一个三层的神经网络(Multi-Layer Adaptive Linear Neurons,MADALINE),但没有找到一个能够用于任意多层网络的、简洁的更新权重系数的方法。由于单层网络有广泛应用而多层网络的运算速度太慢(当时的电脑运算速度是今天的 100 亿分之一),所以在 MADALINE 之后没有人去继续深入探讨多层网络。

由于缺少对人脑工作模式的了解,神经网络的进展一度较为缓慢,而它进入快速发展期的一个触发点则是医学领域的一个发现。1981 年,诺贝尔生理学或医学奖颁发给了美国神经生物学家大卫·胡贝尔(David Hubel)、托尔斯滕·威塞尔(Torsten Wiesel)和罗杰·斯佩里(Roger Sperry)。前两位的主要贡献是发现了人类视觉系统的信息处理采用分级方式,即在人类的大脑皮质上有多个视觉功能区域,从低级至高级分别标定为 V1~V5 等区域,低级区域的输出作为高级区域的输入。人类的视觉系统从视网膜(Retina)出发,经过低级的 V1 区提取边缘特征,到 V2 区的基本形状或目标的局部,再到高层 V4 的整个目标(例如判定为一张人脸),以及到更高层进行分类判断等。也就是说高层的特征是低层特征的组合,从低层到高层的特征表达越来越抽象和概念化。至此,人们了解到大脑是一个多层深度架构,其认知过程也是连续的。

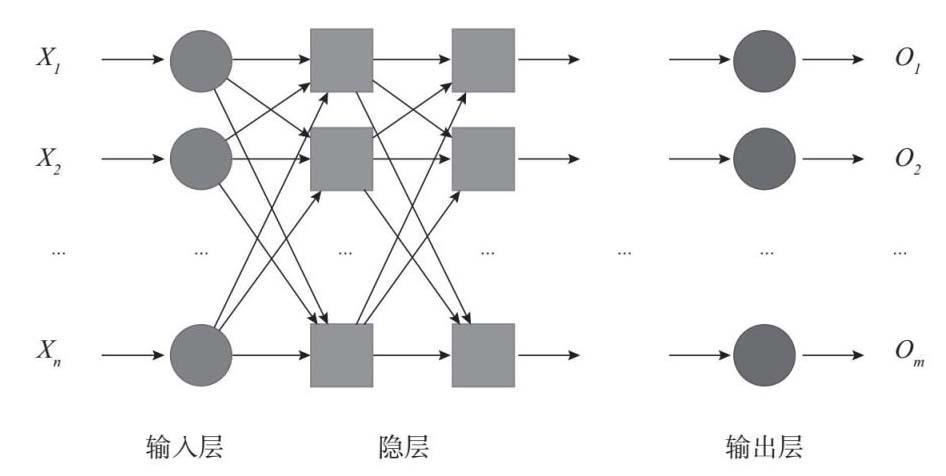

神经网络学习的本质是大量神经元通过复杂的连接形成记忆。因为分析简单且容易用电子元件实现,一开始人工神经网络就如图 3.3 那样由一层一层组成。其实人脑的神经元连接非常复杂,没有这么一层一层的清晰和有秩序。但我们目前并没有弄清楚人脑神经元的连接方式,先从简单的假设入手是科学的一般方法。

使用 App 查看完整内容目前,该付费内容的完整版仅支持在 App 中查看

🔗App 内查看 |